Nvidia La compañía afirmó que la oportunidad de ingresos para sus chips de inteligencia artificial podría alcanzar al menos 1 billón de dólares hasta 2027, al tiempo que delineó una estrategia para competir de forma más agresiva en el mercado de rápido crecimiento de sistemas de IA que funcionan en tiempo real.

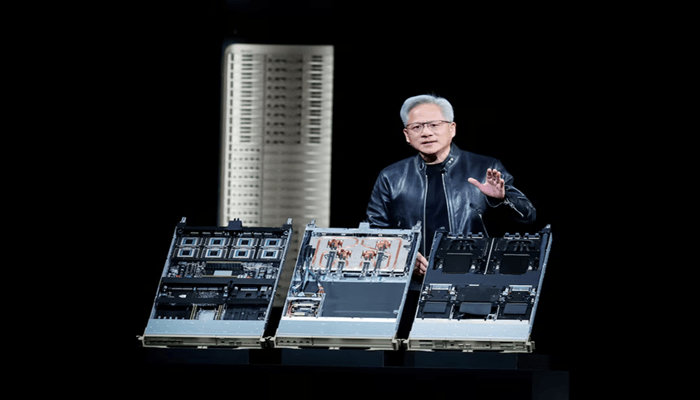

El director ejecutivo Jensen Huang presentó un nuevo procesador central y un sistema de IA basado en tecnología de Groq, una empresa emergente de chips de la que Nvidia obtuvo una licencia tecnológica por 17.000 millones de dólares en diciembre, durante su conferencia anual de desarrolladores GTC en San José, California. Estas medidas forman parte de la estrategia de Huang para consolidar la posición de la compañía en la denominada computación de inferencia, el proceso de responder consultas, donde sus procesadores gráficos se enfrentan a una mayor competencia de las unidades centrales de procesamiento y los procesadores personalizados fabricados por empresas como Google.

Los chips de Nvidia han dominado el proceso de entrenamiento de modelos de IA, que ha sido el foco de atención en los últimos años.

«Ha llegado el punto de inflexión», dijo Huang. «Y la demanda no deja de aumentar», añadió. Vestido con su característica chaqueta de cuero negra, Huang habló en un estadio de hockey con capacidad para más de 18.000 personas, en la conferencia de cuatro días que se ha convertido en uno de los mayores escaparates de la tecnología de IA. «Solo quiero recordarles que esta es una conferencia de tecnología», dijo a la audiencia.

Pero tras una espectacular racha alcista que convirtió a Nvidia en la primera empresa en alcanzar una valoración de 5 billones de dólares el pasado octubre, han surgido dudas sobre su crecimiento. Los inversores también se han preguntado si su plan de reinvertir los beneficios en el ecosistema de la IA dará sus frutos. Las declaraciones de Huang disiparon algunos temores. La previsión de 1 billón de dólares supone un aumento respecto a la oportunidad de ingresos de 500.000 millones de dólares hasta 2026 que Nvidia mencionó para sus chips de IA Blackwell y Rubin en su última conferencia sobre resultados en febrero.

Las acciones de Nvidia subieron brevemente tras el nuevo pronóstico, pero luego moderaron esas ganancias y cerraron con un alza del 1,2%.

«El hecho de que Huang haya trazado un mapa de una oportunidad de 1 billón de dólares hasta 2027 subraya la demanda sostenida de la infraestructura de IA de Nvidia a pesar de las preocupaciones de los inversores», dijo Jacob Bourne, analista de Emarketer. «Esto indica que Nvidia mantiene su liderazgo en el mercado de chips de IA, mientras que la industria de la IA en general se expande más allá de la experimentación inicial hacia el despliegue a gran escala.»

AUGE DE LA INFERENCIA

Huang afirmó que la inferencia, en la que los sistemas de IA responden preguntas o realizan tareas, se dividirá en dos pasos. Los chips Vera Rubin de Nvidia se encargarán de un primer paso llamado «precarga», en el que la solicitud del usuario se transforma de palabras humanas al lenguaje de «tokens» que utilizan las computadoras de IA. Los nuevos chips de Groq se encargarán de una segunda etapa de «decodificación» en la que el ordenador con inteligencia artificial proporcionará la respuesta que busca el usuario.

Después de gastar cientos de miles de millones de dólares en los últimos años en chips para entrenar sus modelos de IA, empresas como OpenAI, Anthropic y Meta están cambiando su enfoque para dar servicio a cientos de millones de usuarios que están utilizando esos sistemas de IA. Esto también está impulsando la demanda de CPU, un mercado dominado por Intel y que cada vez se considera más una alternativa viable a los procesadores gráficos de Nvidia para la implementación de modelos de IA.

«Estamos vendiendo muchos procesadores independientes», dijo Huang al presentar el nuevo procesador Vera. «Sin duda, esto se convertirá en un negocio multimillonario para nosotros», añadió. Huang también presentó la hoja de ruta de Feynman de la compañía, pero ofreció pocos detalles más allá de una lista de los diversos chips que Nvidia planea incluir en la plataforma, incluidos procesadores de IA y varios chips de red. Se espera que la arquitectura Feynman esté disponible en 2028, después de los chips Rubin Ultra de la compañía.

La compañía también apunta al mercado de agentes de IA autónomos con NemoClaw, que se integra con la popular plataforma OpenClaw para agregar controles de privacidad y seguridad a la herramienta que puede ejecutar de forma autónoma una amplia gama de tareas con una mínima intervención humana y que ha generado gran expectación a nivel mundial. «Esto ha elevado el nivel de toda la discusión. Ha elevado el nivel de toda la concepción de cómo se gestiona la infraestructura», dijo Bob O’Donnell, presidente de Technalysis Research, refiriéndose a los anuncios.

«Él (Huang) solía presentar un nuevo chip de GPU y decir: ‘Miren, aquí está mi nuevo chip’. Ahora tiene, ya saben, cinco bastidores de equipos que conforman estos sistemas.» Información de Stephen Nellis y Max Cherney en San José, California, y de Aditya Soni y Arsheeya Bajwa en Bengaluru; edición de Sayantani Ghosh, Ethan Smith y Nick Zieminski.

Fuente: reuters